Personalized Navigation that Links Speaker’s Ambiguous Descriptions to Indoor Objects

利用者の曖昧な説明を屋内のオブジェクトにリンクするパーソナルナビゲーション

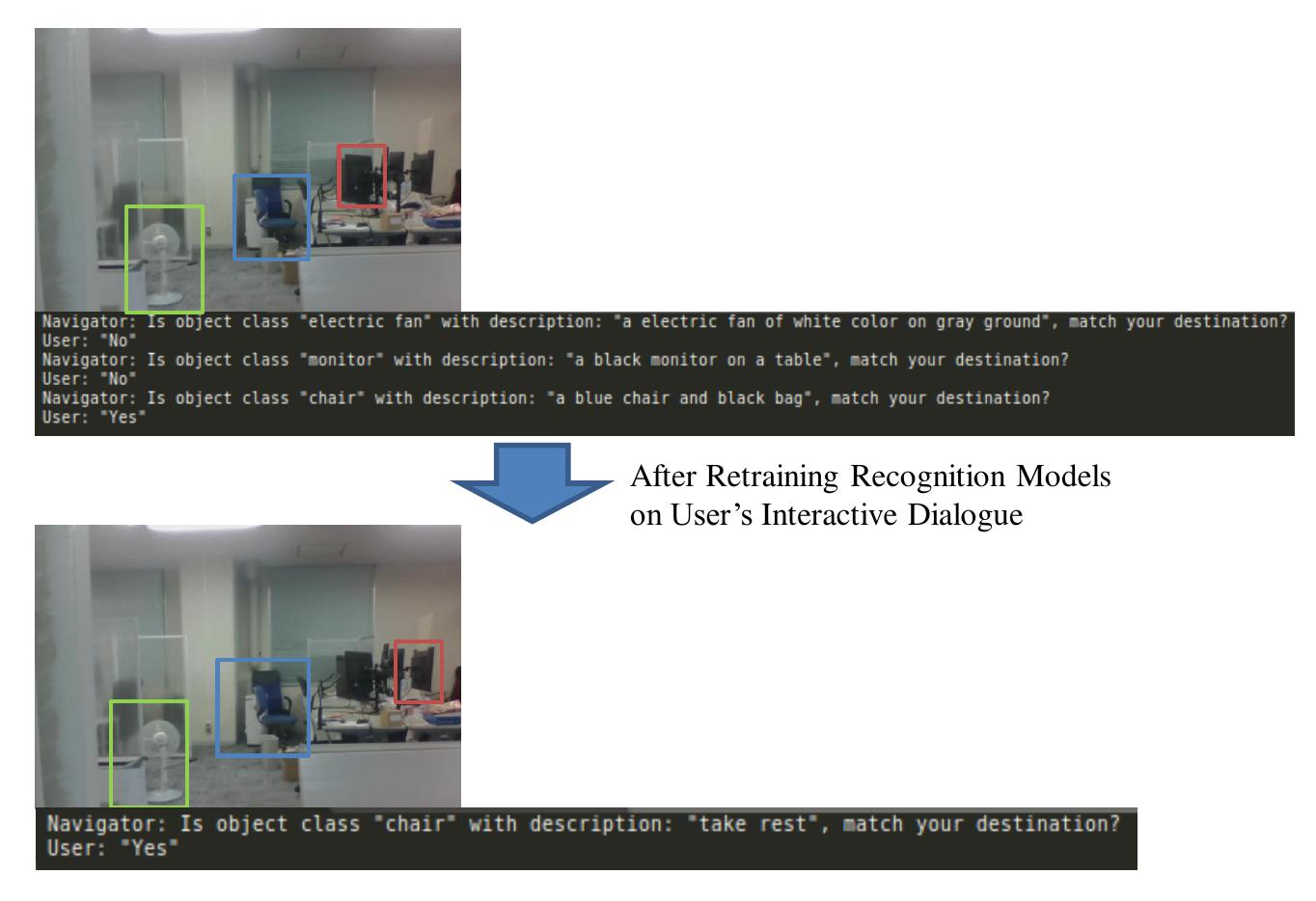

Indoor navigation systems guide a user to his/her specified destination. However, current navigation systems face challenges when a user provides ambiguous descriptions about the destinations. This can commonly happen to visually impaired people or those who are unfamiliar with new environments. For example, in an office, a low-vision person asks the navigator by saying “Take me to where I can take a rest?”. The navigator may recognize each object (e.g., desk) in the office but may not recognize which location the user can take a rest. To overcome the gap of surrounding understanding between low-vision people and a navigator, we propose a personalized interactive navigation system that links user’s ambiguous descriptions to indoor objects. We build a navigation system that automatically detectS and describeS objects in the environment by neural-network models. Further, we personalize the navigation by re-training the recognition models based on previous interactive dialogues, which may contain the corresponding between user’s understanding and the visual images or shapes of objects. Additionally, we utilize a GPU cloud for supporting computational cost and smooth navigation by locating user’s position using Visual SLAM. We discussed further research on customizable navigation with multi-aspect perceptions of disabilities and the limitation of AI-assisted recognition.

屋内ナビゲーションシステムは、ユーザが指定した目的地まで案内します。しかし、現在のナビゲーションシステムでは、ユーザーが目的地について曖昧な説明をした場合に課題があります。これは、視覚障がい者や新しい環境に慣れていない人によく起こる現象です。例えば、オフィスでロービジョンの人が「休憩できるところに連れて行ってください」とナビに声をかけたとします。ナビゲーターは、オフィス内の各物体(机など)は認識していても、どの場所で休憩できるかまでは認識していないかもしれません。本研究では、ロービジョンの人とナビゲーターの間の周囲の理解のギャップを克服するために、ユーザーの曖昧な説明を屋内のオブジェクトに結びつけるパーソナライズされたインタラクティブなナビゲーションシステムを提案します。 本研究では、ニューラルネットワークモデルを用いて、環境中の物体を自動的に検出し、記述するナビゲーションシステムを構築します。さらに、過去の対話に基づいて認識モデルを再学習することで、ナビゲーションをパーソナライズします。この対話には、ユーザの理解とオブジェクトの視覚的なイメージや形状との間の対応関係が含まれている可能性があります。さらに、GPUクラウドを利用して計算コストを削減し、Visual SLAMを用いてユーザの位置を特定することで、ナビゲーションをスムーズにしています。さらに、障害者の多面的な認識によるカスタマイズ可能なナビゲーションの研究と、AI支援による認識の限界について議論しました。

Jun-Li Lu, Hiroyuki Osone, Akihisa Shitara, Ryo Iijima, Bektur Ryskeldiev, Sayan Sarcar, Yoichi Ochiai